Digi Műhely | Adatok használata, védelme, elemzése

Deep learning módszerek interpretálhatósága

Készítette: Gyires-Tóth Bálint

A tanulmányban ismertetett módszereket kutatási és ipari projektekben gyűjtött tapasztalatink alapján összegeztük. Az ismertetett módszerek nem csak a megoldások interpretálhatóságában segítenek, hanem segítségükkel jobban elmélyíthetjük a gyakorlati tudásunkat is az adatok és a mély neurális hálózatok világában.

Mélytanulás (kifejezően fogalmazva: a gépi tanulás „Teslája”): Biológiai indíttatású mesterséges neurális hálózatok strukturált összessége, ahol több rétegen keresztül próbáljuk az adatok különböző szintű absztrakcióit kinyerni és modellezni. Absztrakciónak az adatok mögöttes tartalmát nevezzük. Ha nagyon sok adattal rendelkezünk, amit fel kell dolgozni, akkor az adat előfeldolgozást kevésbé szükséges hangsúlyosra venni, ugyanis az adatok előfeldolgozásán keresztül visszük be a szakértői tudást a rendszerbe.

A mélytanulás kapcsán sokparaméteres nemlineáris egyenletrendszerekről van szó, ahol a paramétereket az adatok alapján vannak kiszámolva.

Az interpretálhatóságot nagyban segíti az új, egyre jobb algoritmusok megjelenése, a hatalmas mennyiségű adat rendelkezésre állása, a grafikus kártyák teljesítményének fejlődése, a nyílt forráskódú kutatások és fejlesztések a területen, illetve az egyre alacsonyabb belépési korlátok. Ezeknek köszönhetően egyre robosztusabbak tudnak lenni ezen technológiák.

Néhány gondolat a „hagyományos” gépi tanulás interpretálhatóságáról:

- A hagyományos infokommunikációs rendszerek interpretálhatósága kapcsán kérdés, hogy mennyire szeretné a társadalom megérteni ezen rendszerek működését. Gondolva itt akár csak egy lefagyó mobiltelefonra, amelyet újraindítással „javítunk meg”. Elromlik a laptopunk, elvisszük szervizbe.

- Ezzel szemben a gépi tanulás interpretálhatósága kritikusabb kérdés: szorosabb kapcsolat lehet szükséges a társadalom és a mesterséges intelligencia között, a felelősséget a társadalom visszakapja a mesterséges intelligencia felett.

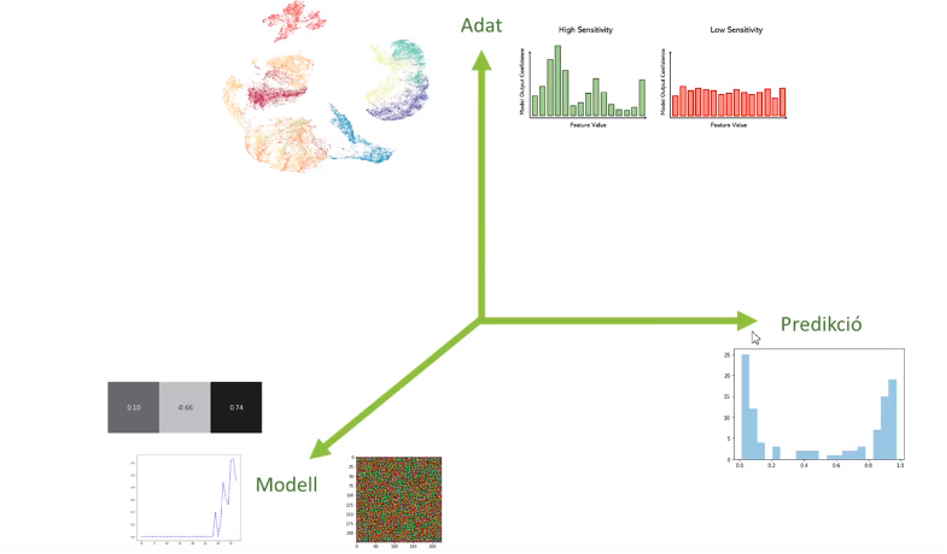

Az interpretálhatóság 3 aspektusa: az Adat a Modell és a Predikció interpretálhatósága, a 3. ábrán látható módon.

- Adat: az adat megértése kritikus fontosságú, azonban szintén fontos magának az üzletnek, annak a tevékenységnek a megértése, amelyből az adatok származnak. A függőleges tengely bal oldalán egy adatstruktúra látható, a jobboldalon pedig érzékenységvizsgálat, amely megmutatja, hogy melyik bemeneti adat mennyire kritikus.

- Predikció: annak megértése szintén fontos, hogy mennyire megbízható, mennyire erős az előrejelzés. A nehézséget az okozza, hogy a modell éles használatakor már nincsen referencia adatunk, amellyel a modell betanításakor össze lehetett hasonlítani az előrejelzést.

- Modell: felmerülő kérdések, melyekre válaszokat kell találni: hogyan magyarázható a modell? Mit tanult meg? Mi alapján magyarázza a döntéseket?

Kulcsszavak: gépi tanuló modellek; deep learning; mélytanulás; mesterséges intelligencia; interpretálhatóság; inkrementális modellezés; regressziós és autoregressziós feladatok; szembetűnőségi térkép; Layer-wise Relevance Propagation (LRP)